Üleilmne koroonapandeemia tõi tähelepanu alla tagasi eksistentsiaalsed ohud inimkonnale. Lisaks pandeemiatele võivad inimkonna kestmist ohustada asteroidid, komeedid, supervulkaanid, täheplahvatused, tuumasõjad, kliimamuutuse ja teised keskkonnakahjud, väärtustega ühildamata tehisintellekt ning muud võimalikud inimtekkelised ohud. Kuigi eksistentsiaalsete ohtude puhul on kaalul palju, siis globaalsed kulud nende ennetamisel väikesed ja jäävad aastas vaid 100 miljoni dollari piiresse.

Eksistentsiaalsed ohud võivad hävitada inimkonna kaugtuleviku potentsiaali. Siia alla kuuluvad nii sellised sündmused, mis hävitaksid kogu inimkonna kui ka sündmused, mis takistaksid inimkonnal oma potentsiaali realiseerimist.1 Ohtudeks võivad olla asteroidid ja komeedid, supervulkaanid, täheplahvatused, tuumasõjad, kliimamuutus, muud keskkonnakahjud, looduslikud või tehislikud pandeemiad, väärtustega ühildamata tehisintellekt1 ja muud võimalikud inimtekkelised ohud1. Nimetatud ohtudest on kõige paremini arusaadavad looduslikud ohud, mida on ka kõige rohkem uuritud. Tõenäoliselt kõige spekulatiivsemad ja vähem tähelepanu saanud on väärtustega ühildamata tehisintellekti ohud.

Käesolevas essees keskendun kliimamuutusele, tehislikele pandeemiatele ja väärtustega ühildamata tehisintellektile sellepärast, et need võivad olla kõige ohtlikumad ja tõenäolisemad eksistentsiaalsed ohud sellel sajandil1 ning, kui Euroopa Liit (EL) tahab, saab nende puhul midagi ette võtta. Eksistentsiaalsetele ohtudele keskendumine on oluline, sest need põhjustaksid kahju väga paljudele inimestele ning muudaksid tuleviku võimatuks või planeedi elamiskõlbmatuks tulevastele põlvkondadele. Isegi kui selliste ohustsenaariumite realiseerumisel inimkond välja ei sure, võivad need põhjustada tsivilisatsiooni kokkuvarisemist ja düstoopilist tulevikku.

Eksistentsiaalsete ohtude olulisus

Inimkonna väljasuremine tähendaks kannatusi ja surma miljardite inimestele2. Võrreldes mõne muu ühiskonnale kahjuliku sündmusega, mis ei ole eksistentsiaalne oht, oleks see palju hullem seepärast, et kannataksid kõik inimesed. Näiteks kui 1% rahvastikust hukkuks, oleks see sada korda vähem katastroofiline kui kogu inimkonna hukkumine.

Teise vaate kohaselt oleks inimkonna väljasuremine veelgi suurem katastroof sellepärast, et see tähendaks inimkonna tuleviku kadu lisaks kõigi praegu elavate inimeste hukkumisele.2 Kui tulevikku poleks, jääksid elamata kõik inimesed, kes muidu elaksid, saavutamata kõik saavutused, mida muidu saavutataks, ja kogemata kõik kogemused, mida muidu kogetaks.

Tulevik on potentsiaalselt väga pikk ja eksistentsiaalseid ohtusid vältides võiks tulevikus elada väga palju inimesi. Kui eeldada, et Maa jääb elamiskõlblikuks veel vähemalt üheks miljardiks aastaks ja vähemalt üks miljard inimest saaks korraga jätkusuutlikult sellel elada, siis võiks vähemalt 1016 normaalse elueaga inimest tulevikus veel elada.3 See tähendab, et eksistentsiaalse ohu realiseerumisel võiks elu elamata jääda kümnel tuhandel triljonil inimesel, seda on umbes sada tuhat korda rohkem, kui on inimesi kunagi üldse elanud.4

Hinnang võib olla konservatiivne, sest see ei võta arvesse võimalikke tehnoloogilisi arenguid ja tsivilisatsioonide rajamist teistele planeetidele. Seega, inimkonna tulevik on potentsiaalselt palju pikem kui olevik ja minevik ning kaalul on palju rohkem inimelusid.

Hoolimata sellest, et eksistentsiaalsete ohtude puhul on kaalul väga palju ja nende esinemise tõenäosus paistab olevat väga kõrge, kulutatakse nende riskide vähendamiseks globaalselt väga vähe ressursse.

Risto Uuk

Inimkonna areng võib aga liiga vara katkeda, sest kliimamuutusest, pandeemiatest, uutest tehnoloogiatest ja teistest ohtudest tingitud sündmused võivad senised saavutused ära rikkuda.

Eksistentsiaalsete ohtude uurimiseks kulutatakse tagasihoidlikult

Nimetatud ohtude esinemise tõenäosust sellel sajandil või umbes järgmise saja aasta jooksul peetakse mitme eksperdi2 hinnangul väga kõrgeks. Ord (2020) hindab tõenäosuseks 17%1, Cotton-Barratt ja teised (2016) hindavad tõenäosuseks 10%5 ning Sandberg ja Bostrom (2008) hindavad tõenäosuseks 19%.6 Kui võtta eksistentsiaalse ohu tõenäosuseks nende hinnangute põhjal umbes 0,1% aastas, siis inimesel on eksistentsiaalse ohu tõttu surma saamise tõenäosus viis korda suurem, kui saada surma autoõnnetuses.5 Neid tõenäosusi tuleb aga ettevaatlikult kasutada, sest need on ekspertide subjektiivsed hinnangud.

Hoolimata sellest, et eksistentsiaalsete ohtude puhul on kaalul väga palju ja nende esinemise tõenäosus paistab olevat väga kõrge, kulutatakse nende riskide vähendamiseks globaalselt väga vähe ressursse. Ord (2020) hindab otseselt eksistentsiaalsetele ohtudele tehtud globaalseid aastaseid kulutusi 100 miljoni dollari suurusjärgus.1 Kõrgelt arendatud tehisintellektist tulenevatele ohtudele kulutatakse vaid mõnikümmend miljonit dollarit7 aastas, kuid tehisintellekti võimekamaks muutmisele kulutatakse miljardeid.8 Tehislikest pandeemiatest tulenevate ohtude vähendamisele kulutatakse suurusjärgus mõni miljon dollarit9, aga bioloogilistele riskidele üldiselt kulutatakse miljardeid dollareid, millest osa võib ka olla eksistentsiaalsete ohtude vähendamiseks kasulik.10

Kliimamuutusele kulutatakse igal aastal globaalselt sadu miljardeid dollareid11, aga ainult väike osa sellest kulub äärmuslike ohtude uurimisele ja ennetustööle.1 Näiteks kulutatakse geoinseneeringule – tehnoloogia3, millega loodetakse vähendada globaalset soojenemist – mõnikümmend miljonit dollarit.12 Seda peaks aga rohkem uurima, muu hulgas ka sellepärast, et sellise tehnoloogia rakendamisel võib globaalne soojenemine hoopis kiireneda.13

Samuti on oluline tõdeda, et paljud inimesed nõustuvad sellega, et eksistentsiaalsete ohtude vähendamine peaks olema üks peaeesmärk. Näiteks Schubert ja teised (2019) uurisid kolme uuringu jaoks kokku üle 2500 Ameerika Ühendriikide ja Suurbritannia elaniku arvamuse ning leidsid, et enamik vastanutest tunneb veendunult, et eksistentsiaalseid ohtusid tuleks ennetada, nende ennetamine on moraalne kohustus ja nende ennetamisele raha kulutamine on olulisem kui teiste valdkondade, näiteks haridus-, tervishoiu- ja sotsiaalkindlustuse valdkonna rahastamine.2

Samas aga ei pea selle uurimuse järgi enamik inimesi eksistentsiaalseid ohtusid väga palju hullemaks muudest katastroofidest, mille korral sureks küll palju inimesi, kuid mitte kõik. Inimesed keskenduvad otsestele kahjudele, mida katastroofid põhjustavad, ning tunnevad tugevalt kaasa kannatanutele, kuid jätavad tähelepanuta kaugtuleviku tagajärjed.

OHT 1: Kliimamuutus

- kontrollimatu kasvuhooneefekt

- igikeltsa sulamine

- katastroof kliimamuutuse peatamisest

- käivitab teised riskid

Ohu realiseerumise võimalikud stsenaariumid

Esimene võimalik stsenaarium kliimamuutuse katastroofiliseks ohuks on kontrollimatu kasvuhooneefekt. Kontrollimatu kasvuhooneefekt tähendab seda, et tekib võimendatud ahel, kus atmosfääri soojenemine põhjustab vee aurustumist atmosfääri, mis omakorda põhjustab atmosfääri soojenemist, mille tulemusena ookeanid aurustuvad ja elu ei ole enam võimalik.1 Seda stsenaariumit peetakse teoreetiliselt võimalikuks, kuid see ei ole arvatavasti võimalik ainult inimtekkeliste heitgaasidega.14,15 Ka selline ahel, mis põhjustab ulatuslikku soojenemist, kuid ookeane täiesti ära ei aurusta, ei paista olevat kõigest inimtekkeliste heitgaaside tagajärjel võimalik, aga teadlased ei ole selles kindlad.1 Isegi kui selline stsenaarium pole võimalik, oleks vaja teha sellel teemal uurimistöö, et kindel olla.1

Teine võimalik stsenaarium kliimamuutuse katastroofiliseks ohuks on selline soojenemise ahel, mis põhjustab igikeltsa sulamise ja sügavast ookeanist metaani eraldumise. Igikeltsas võib olla kaks korda rohkem süsinikku, kui on praegu Maa atmosfääris kokku.16

VOX: Sulav igikelts muudab maastikku ja toob tagasi kadunud haigusi

Teadlased on veendunud, et järgmiste sajandite jooksul igikelts osaliselt sulab, aga pole täpselt teada, milline mõju võib sellel globaalsele soojenemisele olla.17 Samuti on sügaval ookeani põhjas jää sees palju metaani, aga pole täpselt teada, kui palju seal süsinikku kokku on.1 Teadlased on veel vähem kindlad, mis juhtuks siis, kui ookeani põhjast hakkaks eralduma metaani, ja mis aja jooksul muutused toimuksid.1

SULAB: igikeltsa sulamine põhjapoolkeral 2003-2017

Kolmas võimalik stsenaarium kliimamuutuse katastroofiliseks ohuks on see, et inimkond jätkab heitgaaside paiskamist atmosfääri samas tempos või kiirendab seda ja lõpuks tuleb kliimamuutuse peatamiseks rakendada äärmuslikke meetodeid, mis põhjustavad omakorda muu katastroofi. Kui inimkond põletaks peaaegu kõik fossiilkütused, võib see aastaks 2300 põhjustada globaalset soojenemist umbes 9–13 kraadi võrra.18 See võib muuta suurema osa planeedist elamiskõlbmatuks ja laastada põllumajanduse täielikult.13 Kui sellise muutusega toimetulekuks kasutataks geoinseneeringut, võib tagajärg olla katastroofiline. Näiteks võib üks geoinseneeringu rakendus, mille abil püütakse maakera jahutada nii, et peegeldatakse päikesevalgust, enneaegse katkestamise korral põhjustada kiire soojenemise.13

Neljas võimalik stsenaarium kliimamuutuse katastroofiliseks ohuks on see, et kliimamuutus ise ei põhjusta inimkonna väljasuremist, aga osutub riskiteguriks teistele eksistentsiaalsetele ohtudele.1 Selle stsenaariumi järgi suurendab kliimamuutus võimalust, et eksistentsiaalse katastroofi põhjustavad teised eksistentsiaalsed ohud, näiteks väärtustega ühildamata tehisintellekt või tehislik pandeemia. Kliimamuutus riskitegurina võib kaasa aidata majanduslikule stagneerumisele, rahvusvahelise korra rikkumisele ja ühiskonna kokkukukkumisele.19

Ohu realiseerumise tõenäosus 0,01 – 0,1%

Ord (2020) hindab kliimamuutusest tuleneva eksistentsiaalse ohu tõenäosuseks järgmise saja aasta jooksul ligikaudu 0,1%.1 Ta selgitab, et seda arvu ei maksa võtta täielikult objektiivsena, vaid see on tema subjektiivne kindlushinnang, võttes arvesse kõike, mida ta seoses kliimamuutuse ohtudega teab.

Duda ja Koehler (2020) hindavad tõenäosust sarnaseks.20 Nende sõnul on kliimamuutusest tingitud eksistentsiaalse ohu võimalus väike, kuid mitte olematu, viidates võimalustele, et inimesed jätkavad või isegi suurendavad fossiilkütuste kasutamist ning põhjustavad mõne äärmusliku ettearvamatu ahela, mille tagajärjel kuumenemine kiireneb ja väljub kontrolli alt. Pamlin ja Armstrong (2015) hindavad kliimamuutusest tingitud eksistentsiaalse ohu tõenäosuseks järgmise kahesaja aasta jooksul 0,01%.21 Nad tõdevad, et need hinnangud on katse olemasolevaid hinnanguid kokku panna, et julgustada teisi nende hinnangute kindlust parandama.

Kas EL teeb piisavalt? Euroopa Komisjon võttis 2021. aastal vastu uue kliimamuutusega kohanemise strateegia, et valmistuda kliimamuutuse tagajärgedeks, mille hulgas on kuumalained, põuad, metsade hävimine ja merepinna tõus.22 Strateegias tuuakse välja, et lisaks eespool mainitud mingil määral juba esinevate tagajärgedega kohanemisele tuleb ennetada võimalikke suuremaid tagajärgi, nagu igikeltsa sulamine, merejää kadu ja ulatuslik metsade hävimine. ELi peamine algatus nimetatud tagajärgedega kohanemiseks on Euroopa roheline kokkulepe ja selle läbi lubadus saavutada kliimaneutraalsus aastaks 2050.

Euroopa rohelise kokkuleppe järgi on ELi peamised poliitikasuunad ja meetmed järgmised: põhiliselt taastuvatel energiaallikatel põhineva energiasektori loomine, tööstussektori kaasamine puhtaks ringmajanduseks, energiatõhus ehitamine, säästvale transpordile üleminek, keskkonnahoidliku toidusüsteemi kujundamine, ökosüsteemide säilitamine ja taastamine, erinevate kliimaeesmärkide saavutamiseks lisainvesteeringute tegemine ning uute tehnoloogiate edendamine ja rakendamine.23,24 Euroopa Komisjon on teinud ka ettepaneku võtta vastu esimene Euroopa kliimaseadus, et tagada kliimaneutraalsuse saavutamine 2050. aastaks.25

Oluline on rõhutada, et kliimamuutus on üleilmne probleem ja ainult ELi pingutused süsinikku vähendada ei ole piisavad. EL peaks tegema koostööd Ameerika Ühendriikide ja teiste partneritega ning kehtestama ülemaailmseid standardeid.26 Selleks, et ELi tegevused kliimamuutuse ohtude vähendamiseks oleks võimalikult efektiivsed, tasub uurida analüüse kõige kuluefektiivsemate meetmete kohta.

Organisatsioon Let’s Fund on analüüsinud, millised kliimamuutuse meetmed võiksid olla kõige efektiivsemad vastavalt kolmele mõõdikule: ulatus ehk kui suurt osa kliimamuutuse mõjust võib meede lahendada, kõrvalejäetus ehk kui vähe ressursse meetmele praegu suunatakse ja lahendatavus ehk kuivõrd realistlik meetme rakendamine poliitiliselt on.27 Nende hinnangul on kõige efektiivsem suunata rohkem tähelepanu riigi kulutuste suurendamisele puhta energia teadus- ja arendustegevuseks ning mingil määral suurendada ka kliimamuutuste alusuuringute rahastust.

Eriti vähe on teada geoinseneeringu mõjust ja rakendusvõimalustest ning kliimamuutuste äärmuslikest tagajärgedest.20 Mõttekoda Copenhagen Consensus Center on hinnanud kõige efektiivsemaks teadustööd geoinseneeringu kohta ja uuringuid puhta energia tehnoloogiate arendamiseks.28 Organisatsioon Founders Pledge on leidnud, et suur osa tähelepanust rohelise tehnoloogia arendamisel läheb päikese- ja tuuleenergia, energia efektiivsuse ning elektriautode peale, mistõttu oleks vaja rohkem ressursse suunata süsiniku sidumise ja ladustamise, tuumaenergia ning raskeveokite kütuste uurimisele.29

OHT 2: Tehislikud pandeemiad

- patogeenide lekkimine laborist

- bioloogilised relvad

- teave valedes kätes

Ohu realiseerumise võimalikud stsenaariumid

Esimene võimalik stsenaarium tehisliku pandeemia katastroofiliseks ohuks on patogeenide lekkimine teaduslaboritest. Inimesed võivad tulevikus luua selliseid patogeene, mis on väga surmavad, väga kõrge nakatumisriskiga ja väga pika peiteperioodiga.30 Selliste patogeenide puhul nakatunu suure tõenäosusega sureks, paljud inimesed suure tõenäosusega kannaksid patogeeni teistele edasi ja esimesed sümptomid ilmneksid alles siis, kui nakatunu on patogeeni paljudele teistele edasi kandnud.

Näiteks polioviirust ja hobuserõugeid suudavad teadlased juba sünteesida ning on ka eksperimente, mis näitavad grippide ohtlikkuse suurendamise võimalikkust.31 Laboritest on patogeene palju kordi välja lekkinud hoolimata sellest, et need on tavaliselt rangelt kaitstud. Näiteks 1971. aastal katsetas Nõukogude Liidu biorelvade labor rõugete kasutamist relvana ning lekkimise tulemusena nakatus kümme inimest ja suri kolm inimest enne, kui levik suudeti peatada.1

Teine võimalik stsenaarium tehisliku pandeemia katastroofiliseks ohuks on bioloogiliste relvade kasutamine. Bioloogiliste relvade kasutamine sõjas või terroristide poolt ei ole ajalooliselt võrreldes looduslike pandeemiatega eriti palju kahju tekitanud. Ühe kõige surmavama pandeemia, musta surma katkupandeemia tagajärjel suri vähemalt 75 miljonit inimest 450 miljonist inimesest kogu maailmas.30 Biorelvade tagajärjel aga sai Teises maailmasõjas ühes kõige surmavamas juhtumis surma umbes 200 000 hiinlast.32 See aga ei tähenda, et tulevikus ei võiks biorelvade tagajärjel olla ohustatud väga suur osa rahvastikust sellepärast, et biotehnoloogia tõttu võivad sõjas või terrorismis kasutatavad patogeenid ohtlikumaks muutuda.

Kolmas võimalik stsenaarium tehisliku pandeemia katastroofiliseks ohuks on biotehnoloogia demokratiseerumine ja teabeohud. Biotehnoloogia areneb kiirelt ja selle tõttu muutub biotehnoloogia kasutamine odavamaks ja kättesaadavamaks. Näiteks esimese inimese genoomi järjestuse loomise maksumus oli hinnanguliselt umbes üks miljard dollarit, praegu aga maksab terve genoomi järjestamine ligikaudu 600 eurot.1 Tehisliku pandeemia oht suureneb ka sellepärast, et biotehnoloogia võib sattuda rohkemate pahatahtlike inimeste kätte või lihtsalt suurendada õnnetuste arvu. Samuti on võimalus, et informatsioon selle kohta, kuidas luua väga surmavat, nakkavat ja pika inkubatsiooniperioodiga patogeeni, levib üksikute inimeste käest rohkemateni ning jõuab lõpuks valede inimesteni.

Ohu realiseerumise tõenäosus 0,00013%-0,005%

Millett ja Snyder-Beattie (2017) ühe mudeli järgi on eksistentsiaalse ohu tõenäosus biotehnoloogia tagajärjel sellel sajandil ligikaudu 0,00013% kuni 0,0066%.33 Autorid tõdevad, et nende mudeli tõenäosushinnang on väga konservatiivne, kuid võtab arvesse seda, et teadlased ise tahtlikult põhjustavad kahju, tsivilisatsioon kukub pandeemia tõttu kokku või muid kõige hullemaid stsenaariume. Nende teise mudeli järgi on eksistentsiaalse ohu tõenäosus biorelvade kasutamise tagajärjel sellel sajandil ligikaudu 0,005%. Autorid rõhutavad, et nende hinnangud on väga ebakindlad ja tuginevad mingil määral spekulatsioonile ning neid madalaid tõenäosusi ei peaks enesekindlalt kasutama sellepärast, et need ei võta arvesse potentsiaalselt kõige suuremat ohuallikat tulevikus, milleks on tehnoloogiline areng ja biorelvade lai kättesaadavus.

Sandberg ja Bostrom (2008) küsisid Oxfordi globaalse katastroofilise riski konverentsil osalejate käest, kui suur on nende arvates tõenäosus, et selle sajandi jooksul põhjustab tehislik pandeemia inimkonna väljasuremise.6 Vastanute mediaanhinnang oli 2%. Seda hinnangut peaks kasutama eriti ettevaatlikult, sest tegemist on subjektiivse hinnanguga ja raportis ei ole ülevaadet küsimustele vastanute kohta. Samas aga tasub mainida, et küsitletute mediaanhinnang sellele, kui suur on tõenäosus, et selle sajandi jooksul sureb vähemalt üks miljon inimest loodusliku pandeemia tagajärjel, oli 60%. Praeguseks on COVID-19 tõttu juba üle ühe miljoni inimese maailmas surnud, seega võib seda kindlushinnangut pidada veenvaks.

Kas EL teeb piisavalt? ELis võeti 2013. aastal vastu ELi terviseohutuse raamistik, milles toodi välja, kuidas parandada valmisolekut ja tugevdada suutlikkust koordineeritud reageerimiseks tõsistele piiriülestele terviseohtudele.34 Raamistikus on nimetatud järgmised suunad: riikliku valmisoleku kavandamise koordineerimine, heade tavade ja teabe jagamise tugevdamine, kiirhoiatussüsteemi haldamine tõsistest terviseohtudest teatamiseks, riskihindamise ja -juhtimise parandamine, meditsiiniliste vastumeetmete ühishangete väljatöötamise ja kasutuselevõtu kehtestamine, parem reageerimise koordineerimine ELi tasandil ning rahvusvahelise koostöö ja üleilmsete meetmete edendamine.35 ELi terviseohutuse raamistikus küll korra mainitakse bioterrorismi, kuid selle lähenemine ei ole otseselt suunatud sellistele tehislike pandeemiate stsenaariumitele nagu patogeenide lekkimine teaduslaboritest, biorelvade kasutamine, biotehnoloogia demokratiseerumine ja teabeohud.

2015. aastal edastasid teaduskomiteed Euroopa Komisjonile teaduslikke nõuandeid selle kohta, mida poliitikakujundamisel arvesse võtta seoses sünteetilise bioloogia ohtudega ja milline peaks olema riskianalüüsi metodoloogia.36 Raportis mainitakse pealiskaudselt patogeenide lekkimist teaduslaboritest ja biotehnoloogia demokratiseerumist. Autorid tõdevad, et biotehnoloogia laiem kasutus võib ohtusid suurendada, kuid peavad seda võimalust vähetõenäoliseks, kui kasutajad on hästi informeeritud ja ettevaatlikud. Nad rõhutavad ka teadlikkuse suurendamise, koolitamise ja headest laboritavadest kinnihoidmise tähtsust. Kuna sünteetiline bioloogia areneb väga kiiresti ja sisaldab loomult teaduslikku teadmatust, tuleks selliseid riskianalüüse regulaarselt üle vaadata, täiendada ja korrata.36 Selleks oleks vaja kokku panna eksperdirühm, kes analüüsiks põhjalikult võimalikke ohustsenaariume ja meetmeid ohtude vähendamiseks. Näiteks Suurbritannias moodustati hiljuti selline eksperdirühm, et hinnata valitsuse lähenemisviisi biotehnoloogia ohtudele.37

Lisaks tuleb mainida COVID-19 pandeemiat kui kõige viimast juhtumiuuringut, mille näitel aru saada ELi nõrkustest pandeemiateks ettevalmistumisel. 2021. aasta 24. märtsi seisuga oli ELis olnud kokku üle 590 000 koroonaviirusega seotud surma võrreldes Ameerika Ühendriikide üle 540 000 surma, Lõuna-Ameerika üle 520 000 surma ja Aasia üle 410 000 surmaga.38 Miljoni elaniku kohta on Ameerika Ühendriigid surmade poolest esimesed üle 1600 surmaga, EL teine üle 1300 surmaga, Lõuna-Ameerika kolmas üle 1200 surmaga ja Aasia neljas kõigest üle 80 surmaga.39 EL polnud koroonaviiruse pandeemiaks piisavalt valmis – puudu oli meditsiinilistest vahenditest, tervisetöötajad olid ülekoormatud, haiglate võimekus viidi üle piiri ning riskirühmad kannatasid liiga palju.40 Samuti on EL teinud vigu koroonaviiruse vastu vaktsineerimise tegevuses.41 Ainuüksi selle info põhjal võib öelda, et EL peaks paremini valmistuma tehislikeks pandeemiateks, millel võivad olla veel hullemad tagajärjed.

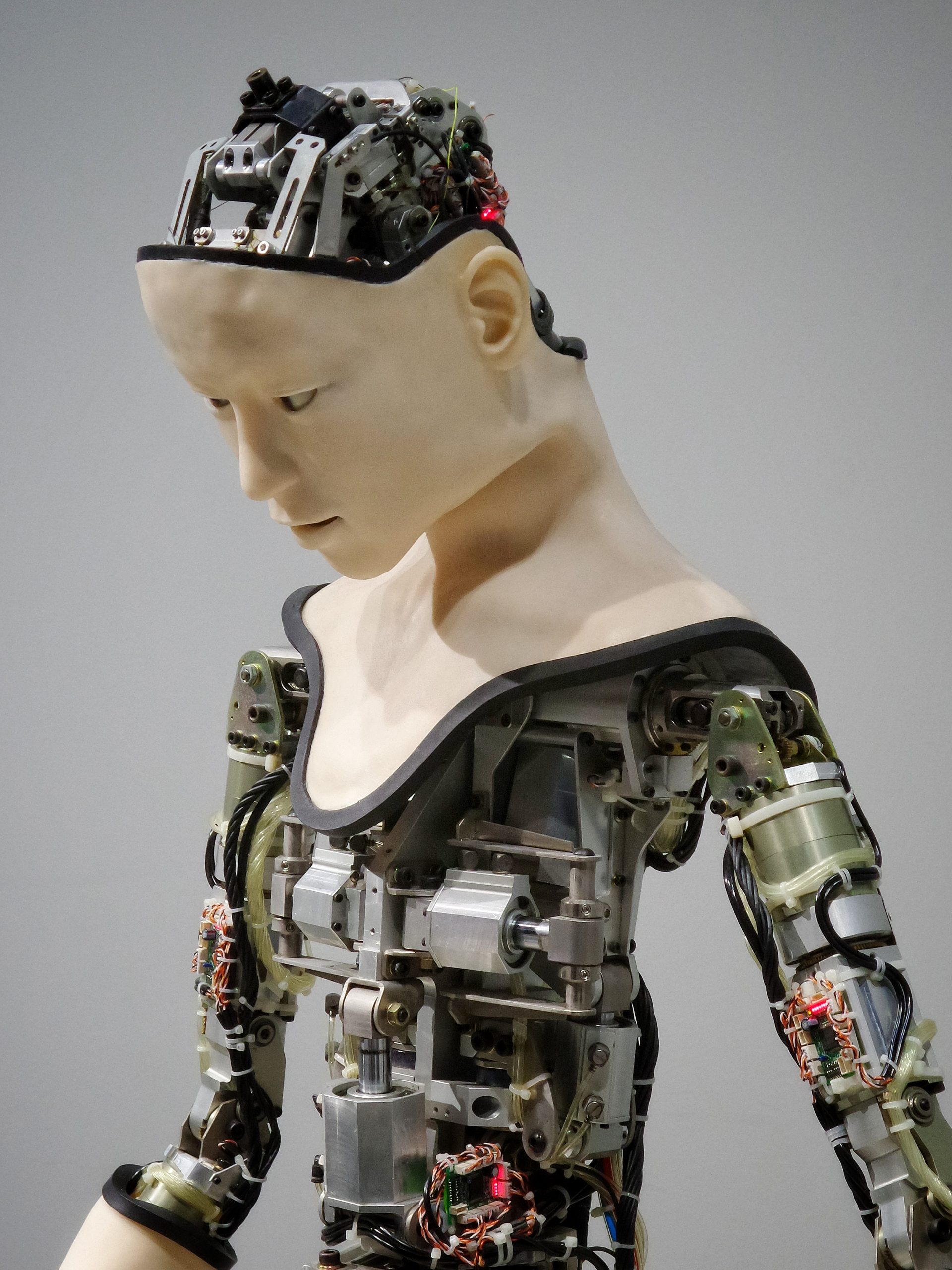

OHT 3: Väärtustega ühildamata tehisintellekt

- tehisintellekt teeb katastroofilise vea

- kaasnevad ühiskondlikud mõjud

- tehisintellekti kasutamine sõjas

- võimu äraandmine tehisintellektile

Ohu realiseerumise võimalikud stsenaariumid

Esimene võimalik stsenaarium tehisintellekti katastroofiliseks ohuks on suutmatus panna tehisintellekti inimeste eesmärkidele vastavalt tegutsema. Selle stsenaariumi puhul õpetatakse tehisintellekti saavutama inimestele vajalikku eesmärki, aga see ei ole edukas ja tehisintellekt teeb vigu, millel on katastroofilised tagajärjed.30 Inimväärtusi on keeruline masinatele tehniliselt edasi anda sellepärast, et nad ei pruugi aru saada inimeste eesmärkidest ning nad ei pruugi suuta neid eesmärke õigesti ellu viia ja arengu käigus säilitada.30 Kui tegemist on robottolmuimejaga, siis selle vead on üpris leebete tagajärgedega, näiteks ei saa tuba ühtlaselt puhtaks. Kui aga tehisintellekti süsteem on võimekam, näiteks isejuhtivate autode võrgustik või tark linn, võib vigade tagajärg olla palju hullem.

Teine võimalik stsenaarium tehisintellekti katastroofiliseks ohuks on inimväärtustest puudulik arusaamine ja seetõttu masinate valel eesmärgil kasutamine. Selle stsenaariumi puhul masinaid küll suudetakse treenida tegema täpselt seda, mida inimesed tahavad, kuid nende kasutamine võib viia katastroofini, kui inimeste eesmärgid on valed ehk ei arvesta korrektselt kaasnevaid sotsiaalseid ja ühiskondlikke mõjusid.42 Kui riikide valitsejad jõuavad üksmeelele ühes õiges moraaliteoorias, mille järgi kogu maailma valitseda, võib ka see viia düstoopiani, kui nende moraaliteooria osutub tegelikult ikkagi ekslikuks (paljude inimeste olukorda halvendavaks) ja nende kasutuses on ülivõimekas tehisintellekt.

Kolmas võimalik stsenaarium tehisintellekti katastroofiliseks ohuks on inimeste pahatahtlik tehisintellekti kasutus. Selle stsenaariumi puhul kasutatakse tehisintellekti otseselt pahatahtlikul eesmärgil, näiteks autonoomsete relvasüsteemide kasutamine massitapmisteks.30 Samuti võib autonoomsete relvasüsteemide loomine põhjustada rahvusvahelist võidurelvastumist, mis suurendab suurte võimude vahelise sõja puhkemise võimalust.30 Lisaks sõjalistele sekkumistele võidakse tehisintellekti kasutada ka demokraatia õõnestamiseks ning seda juba tehaksegi sotsiaalmeedias levivate libauudiste ja muude tegevustega.43

Neljas võimalik stsenaarium on tehisintellektile järkjärguline või järsk võimu äraandmine. Selle stsenaariumi puhul on võimalus, et tehisintellektile antakse järk-järgult üle majanduslikud ja muud ülesanded, kuni lõpuks kontrollib tehisintellekt ühiskonda peaaegu täielikult.1 Samuti on võimalus, et toimub teaduslik murrang, mille tulemusel muutub tehisintellekt, mida ühiskonnas mingite ülesannete täitmiseks kasutatakse, plahvatuslikult järjest võimekamaks ning inimestel kaob selle arengu ja käitumise üle kontroll.44 Kui sellise ülivõimeka tehisintellekti käitumine ei ole inimeste väärtustega kooskõlas, viib see katastroofiliste tagajärgedeni.

Ohu realiseerumise tõenäosus

Müller ja Bostrom (2016) küsitlesid tehisintellekti eksperte selle kohta, millal saavutatakse inimtasemel tehisintellekt ning kas see saavutus toob ühiskonnale kasu või kahju.45 Nende definitsiooni järgi on inimtasemel tehisintellekt selline tehisintellekt, mis suudab enamiku inimeste töid teha vähemalt sama hästi kui keskmine inimene. Nad küsitlesid nelja gruppi: tehisintellekti filosoofia konverentsil osalejad, üldintellekti4 mõju ja ohtude konverentsil osalejad, Kreeka tehisintellekti assotsiatsiooni liikmed ning 100 kõige tsiteeritumat tehisintellekti autorit.

Kokku vastas küsitlusele 170 inimest (31%). Kõikide gruppide peale kokku peeti inimtasemel tehisintellekti saavutamist võimalikuks 50% tõenäosusega aastaks 2040 mediaani järgi ja aastaks 2081 keskmise järgi. Küsimusele, et kui inimtasemel tehisintellekt saavutatakse, siis kas sellel oleks inimkonnale positiivne või negatiivne pikaajaline mõju, vastasid küsitletud, et 18% tõenäosusega (keskmise järgi) oleks sellel saavutusel väga halb mõju ehk see põhjustaks eksistentsiaalse katastroofi. See arvamus erines grupiti – 1. grupp hindas tõenäosuseks 18%, 2. grupp 24%, 3. grupp 6% ja 4. grupp 8%. Kui usaldame kõige enam viimase grupi hinnangut, mille moodustasid kõige tsiteeritumad autorid, siis oleks eksistentsiaalse ohu võimalus inimtasemel tehisintellekti loomise korral ikkagi väga kõrge.

Grace ja teised (2018) küsitlesid tehisintellekti eksperte selle kohta, millal saavutatakse kõrgetasemeline masinintellekt ja kas see saavutus oleks inimkonnale kasulik või kahjulik.46 Nende definitsiooni järgi on kõrgetasemeline masinintellekt saavutatud siis, kui masinad suudavad ilma inimeste abita sooritada kõiki ülesandeid paremini ja odavamalt kui inimtöölised. Nad küsitlesid 2015. aastal toimunud konverentsidel NIPS ja ICML (kaks enim hinnatud masinõppe konverentsi) osalenud eksperte. Kokku vastas küsitlusele 352 inimest 1634-st ehk 21%.

Ekspertide keskmise hinnangu järgi saavutatakse kõrgetasemeline masinintellekt 50% tõenäosusega 45 aasta jooksul ja 10% tõenäosusega 9 aasta jooksul. Aasiast pärit teadlased arvasid, et see saavutatakse 30 aasta jooksul, Põhja-Ameerika teadlased aga, et 74 aasta jooksul. Teadlased hindasid, et kõrgetasemeline masinintellekt põhjustaks väga halva tagajärje, näiteks inimkonna väljasuremise, 5% tõenäosusega. Samuti arvasid teadlased, et ühiskond peaks pigem rohkem prioriseerima tehisintellekti ohtude minimeerimisega tegelevat teadustööd. Artikli juhtivautor aga ei arva, et ekspertide subjektiivseid hinnanguid peaks tugeva tõendina käsitletavas küsimuses kasutama.47

Kas Euroopa Liit teeb piisavalt? ELis on tehisintellekti ohtudega tegelenud aastast 2018 kõrgetasemeline tehisintellekti eksperdirühm, mille pani kokku Euroopa Komisjon 52 liikmest ja mis tegutses kaks aastat.48 Selle aja jooksul koostas eksperdirühm usaldusväärse tehisintellekti eetikajuhendi, milles toodi tehisintellekti süsteemide usaldusväärsuse saavutamiseks välja seitse peamist nõuet.49

7 nõuet tehisintellekti süsteemidele:

- inimese toimevõime ja järelevalve ehk et inimestel oleks masinate üle kontroll, mitte vastupidi,

- tehniline töökindlus ja ohutus,

- privaatsus ja andmehaldus,

- läbipaistvus,

- mitmekesisus, mittediskrimineerimine ja õiglus,

- ühiskondlik ja keskkonnaalane heaolu ning

- vastutuse võtmine.

Eksperdirühma tööd on kõige teravamalt kritiseerinud eksperdirühma liige filosoofiaprofessor Thomas Metzinger, kes ütleb, et koostatud eetikajuhend ignoreerib pikaajalisi tehisintellektiga seotud ohtusid nagu tehisintellekti abil kodanike üle järelevalve pidamist ja sellise tehisintellekti kasutamist, mida inimesed ei suuda enam kontrollida ega võta tugevamat hoiakut surmavate autonoomsete relvasüsteemide suhtes.50

Euroopa Komisjon tutvustas tehisintellekti regulatsiooni 51,52,, ettepanekuid aprillis 2021. Esimeses tehisintellekti regulatsiooni ettepanekus on järgmised põhilised mõtted: kehtivas õigusraamistikus tuleb teha võimalikud kohandused, mis puudutavad tehisintellekti; fookuses peab olema, kuidas viia kõige suuremate riskide võimalus miinimumini, ning kõrge riskitasemega tehisintellekti rakendustele peaksid olema määratud erinõuded standardite ja muude meetmete abil.51

Samuti on ettepanekus kirjas, et tuleb täpselt määratleda, kes vastutavad kõrge riskitasemega tehisintellekti rakenduste ohtude eest, kontrollida ja tagada, et kohustuslikud nõuded oleksid objektiivse vastavushindamise alusel täidetud, ning luua riiklike pädevate asutuste koostööraamistik, et vältida vastutuse killustamist ja suurendada liikmesriikide suutlikkust.

Ühendkuningriik on nüüdseks EList välja astunud, aga pikaajalise ELi liikmena on neil mitu tehisintellekti ohutusega seotud organisatsiooni, mida tasub siin nimetada.

Cambridge’is asuv Centre for the Study of Existential Risk tegeleb muu hulgas ka tehisintellekti ohtude uurimisega. Nende põhiline soovitus Euroopa Komisjonile on säilitada tehisintellekti regulatsiooni ettepanekus pakutud ideid ning mitte muuta neid näiteks korporatsioonide survel nõrgemaks.53 Sellega saab EL kujundada globaalseid standardeid ja võtta liidripositsiooni usaldusväärse tehisintellekti arendamises.

Oxfordis asuv Future of Humanity Institute, mis tegeleb samuti muude teemade kõrval tehisintellektist tulenevate eksistentsiaalsete ohtude uurimisega, soovitas Euroopa Komisjonil võtta rohkem arvesse laiaulatuslikke ohtusid. Nende hinnangul tuleb pidada ülevaadet lisaks sellele, milline on kõrge ohuga tegevusvaldkonna võimalik kahju indiviididele, ka selle üle, kuidas tehisintellekt võib ohustada avalikke huvisid, kui palju kasutajaid konkreetsel tehisintellekti rakendusel on ja kui sagedasti seda kasutatakse, kuid üldjoontes nõustuvad ELi lähenemisega.54

Kokkuvõte

Eksistentsiaalsed ohud peaksid olema ELi prioriteet ühest küljest sellepärast, et nende realiseerumisel kannataksid väga paljud praegu elavad inimesed, kuid ka sellepärast, et nende tõttu jääks olemata kogu inimkonna tulevik koos kõikvõimalike inimkonna saavutuste ja hüvedega. Eksistentsiaalsete ohtude vähendamiseks kulutatakse nii globaalselt kui ka ELis arvatavasti liiga vähe ressursse, kuigi paljud eksperdid ja tavainimesed nõustuvad, et see peaks olema eelisvaldkond.

Eksistentsiaalsed ohud paistavad olevat sellel sajandil väga kõrged – mõne eksperdi arvamusel isegi ligikaudu 20% – kuigi enesekindlus nendes hinnangutes ei saa olla kõrge.

Risto Uuk

Peamised eksistentsiaalsed ohud, mida olen siin käsitlenud, on kliimamuutus, tehislikud pandeemiad ja väärtustega ühildamata tehisintellekt, kuigi võimalikke ohtusid on veel teisigi. Eksistentsiaalsed ohud paistavad olevat sellel sajandil väga kõrged – mõne eksperdi arvamusel isegi ligikaudu 20% – kuigi enesekindlus nendes hinnangutes ei saa olla kõrge.

Kliimamuutusest tulenevad katastroofilised stsenaariumid võivad olla:

- kontrollimatu kasvuhooneefekt,

- igikeltsa sulamine ja sügavast ookeanist metaani eraldumine,

- fossiilkütuste kasutamise jätkamine või kiirendamine,

- äärmuslike meetodite rakendamine kliimamuutuse peatamiseks ning kliimamuutuse osutumine riskiteguriks teistele eksistentsiaalsetele ohtudele.

Tehislikest pandeemiatest tulenevad katastroofilised stsenaariumid võivad olla:

- patogeenide lekkimine teaduslaboritest,

- bioloogiliste relvade kasutamine

- biotehnoloogia demokratiseerumine ja teabeohud.

Väärtustega ühildamata tehisintellektist tulenevad katastroofilised stsenaariumid võivad olla:

- suutmatus panna tehisintellekti inimeste eesmärkidele vastavalt tegutsema,

- masinate valel eesmärgil kasutamine inimväärtustest puuduliku arusaamise tõttu,

- inimeste pahatahtlik tehisintellekti kasutamine

- tehisintellektile järkjärguline või järsk võimu äraandmine.

Kui Euroopa Liit tahab, saab ta midagi nimetatud eksistentsiaalsete ohtudega ette võtta. Kliimamuutuse tagajärgede leevendamiseks ja vältimiseks on EL vastu võtnud uue kliimamuutusega kohanemise strateegia, algatanud Euroopa rohelise kokkuleppe ja Euroopa kliimaseaduse. Siiski on oluline üle vaadata, kas oleks võimalik kulutada rohkem ressursse kliimamuutuse äärmuslike ohtude uurimisele ja kõige kuluefektiivsematele, kuid tähelepanuta jäänud meetmetele.

Tehislike pandeemiate puhul on asjakohased algatused olnud ELi terviseohutuse raamistik ja 2015. aastal sünteetilise bioloogia (loe ka Petri-Jaan Lahtvee kirjutatud Pikksilma artiklit sünteetilisest bioloogia võimalustest) ohtusid uuriva eksperdirühma loomine, kuid vaja oleks uut eksperdirühma, kes hindaks eelkõige just kõige ohtlikumaid tehislike pandeemiate stsenaariume uute tehnoloogiliste arengute valguses.

Väärtustega ühildamata tehisintellekti ohtude vähendamiseks on ELis asjakohased algatused olnud 2018. aastal loodud kõrgetasemeline tehisintellekti eksperdirühm ja praegu kavandatav tehisintellekti regulatsioon. Samas peaks EL arvestama rohkem laiaulatuslike ohtude ja tuleviku ohtudega.

Artikkel ilmus trendiraportis Pikksilm 2022

Risto Uuk on Future of Life Institute’i poliitikaanalüütik. Loe ka https://ristouuk.com.

Kasutatud allikad

1. Ord, T. The Precipice: Existential Risk and the Future of Humanity. (Hachette Books, 2020).

2. Schubert, S., Caviola, L. & Faber, N. S. The Psychology of Existential Risk: Moral Judgments about Human Extinction. Sci. Rep. 9, 15100 (2019).

3. Bostrom, N. Existential Risk Prevention as Global Priority. Glob. Policy 4, 15–31 (2013).

4. Toshiko, K. & Haub, C. How Many People Have Ever Lived on Earth? https://www.prb.org/howmanypeoplehaveeverlivedonearth/ (2020).

5. Cotton-Barratt, O., Farquhar, S., Halstead, J., Schubert, S. & Snyder-Beattie, A. GLOBAL CATASTROPHIC RISKS 2016. https://globalchallenges.org/wp-content/uploads/2019/07/Global-Catastrophic-Risk-Annual-Report-2016.pdf (2016).

6. Sandberg, A. & Bostrom, N. Global Catastrophic Risks Survey. 1–5 https://www.fhi.ox.ac.uk/reports/2008-1.pdf (2008).

7. Farquhar, S. Changes in funding in the AI safety field. Centre for Effective Altruism https://www.centreforeffectivealtruism.org/blog/changes-in-funding-in-the-ai-safety-field (2017).

8. Worldwide Spending on Artificial Intelligence Systems Will Grow to Nearly $35.8 Billion in 2019, According to New IDC Spending Guide. https://www.businesswire.com/news/home/20190311005093/en/Worldwide-Spending-on-Artificial-Intelligence-Systems-Will-Grow-to-Nearly-35.8-Billion-in-2019-According-to-New-IDC-Spending-Guide (2019).

9. Biological Weapons Convention – Budgetary and Financial Matters. https://www.unog.ch/80256EDD006B8954/(httpAssets)/1FE92995054B8108C1258394004233AD/$file/2019-0131+2018+MSP+Chair+letter+on+financial+measures.pdf (2019).

10. Watson, C., Watson, M., Gastfriend, D. & Sell, T. K. Federal Funding for Health Security in FY2019. Health Secur. 16, 281–303 (2018).

11. Buchner, B. et al. Global Landscape of Climate Finance 2017. https://www.climatepolicyinitiative.org/publication/global-landscape-of-climate-finance-2017/ (2017).

12. Geoengineering Research. Open Philanthropy https://www.openphilanthropy.org/research/cause-reports/geoengineering (2013).

13. Existential Risk Diplomacy and Governance. https://www.fhi.ox.ac.uk/wp-content/uploads/Existential-Risks-2017-01-23.pdf (2017).

14. Goldblatt, C., Robinson, T. D., Zahnle, K. J. & Crisp, D. Low simulated radiation limit for runaway greenhouse climates. Nat. Geosci. 6, 661–667 (2013).

15. Ramirez, R. M., Kopparapu, R. K., Lindner, V. & Kasting, J. F. Can Increased Atmospheric CO2 Levels Trigger a Runaway Greenhouse? Astrobiology 14, 714–731 (2014).

16. Zimov, S. A., Schuur, E. A. G. & Chapin, F. S. Permafrost and the Global Carbon Budget. Science 312, 1612–1613 (2006).

17. Tarnocai, C. et al. Soil organic carbon pools in the northern circumpolar permafrost region. Glob. Biogeochem. Cycles 23, (2009).

18. Tokarska, K. B., Gillett, N. P., Weaver, A. J., Arora, V. K. & Eby, M. The climate response to five trillion tonnes of carbon. Nat. Clim. Change 6, 851–855 (2016).

19. Richards, C. E., Lupton, R. C. & Allwood, J. M. Re-framing the threat of global warming: an empirical causal loop diagram of climate change, food insecurity and societal collapse. Clim. Change 164, 49 (2021).

20. Duda, R. & Koehler, A. Report: Is climate change the biggest problem in the world? 80,000 Hours https://80000hours.org/problem-profiles/climate-change/ (2020).

21. Pamlin, D. & Armstrong, S. Twelve risks that threaten human civilisation. https://static1.squarespace.com/static/59dc930532601e9d148e3c25/t/5abf5a638a922d9f4625aff9/1522489978866/12+Risks+with+infinite+impact-Executive+Summary.pdf (2015).

22. Kliimamuutuste suhtes vastupanuvõimelise Euroopa kujundamine – ELi uus kliimamuutustega kohanemise strateegia. https://eur-lex.europa.eu/legal-content/ET/TXT/?uri=CELEX:52021DC0082 (2021).

23. Euroopa roheline kokkulepe. https://eur-lex.europa.eu/legal-content/ET/TXT/?qid=1576150542719&uri=COM%3A2019%3A640%3AFIN (2019).

24. EU climate action and the European Green Deal. Climate Action – European Commission https://ec.europa.eu/clima/policies/eu-climate-action_en (2019).

25. Euroopa kliimaseadus. Kliimameetmed – Euroopa Komisjon https://ec.europa.eu/clima/policies/eu-climate-action/law_et (2020).

26. Wolff, M. L., Jean Pisani-Ferry, Jeremy Shapiro, Simone Tagliapietra, Guntram. The geopolitics of the European Green Deal. European Council on Foreign Relations https://ecfr.eu/publication/the-geopolitics-of-the-european-green-deal/ (2021).

27. Clean Energy Innovation. Let’s Fund https://lets-fund.org/clean-energy/ (2019).

28. Lane, L., Bickel, E., Galiana, I., Green, C. & Bosetti, V. Fix The Climate: Advice for Policymakers. https://www.copenhagenconsensus.com/publication/fix-climate-advice-policymakers (2009).

29. Halstead, J. Climate Change Cause Area Report. https://founderspledge.com/research/fp-climate-change (2018).

30. Global Catastrophic Risks 2017. https://globalchallenges.org/initiatives/analysis-research/reports/ (2017).

31. Lewis, G. Reducing global catastrophic biological risks. 80,000 Hours https://80000hours.org/problem-profiles/global-catastrophic-biological-risks/ (2020).

32. Harris, S. H. Factories of Death: Japanese Biological Warfare, 1932–45 and the American Cover-Up. (Routledge, 2002).

33. Millett, P. & Snyder-Beattie, A. Existential Risk and Cost-Effective Biosecurity. Health Secur. 15, 373–383 (2017).

34. EUROOPA PARLAMENDI JA NÕUKOGU OTSUS nr 1082/2013/EL, 22. oktoober 2013, tõsiste piiriüleste terviseohtude kohta ja millega tunnistatakse kehtetuks otsus nr 2119/98/EÜ. (2013).

35. Health security and infectious diseases. European Commission https://ec.europa.eu/health/security/overview_en (2020).

36. Opinion on Synthetic Biology II: Risk assessment methodologies and safety aspects. https://ec.europa.eu/health/sites/health/files/scientific_committees/emerging/docs/scenihr_o_048.pdf (2015).

37. Nelson, C. et al. UK Government’s approach to emerging infectious diseases and bioweapons. https://www.fhi.ox.ac.uk/wp-content/uploads/UKG-Biosecurity-Written-Submission-C-Nelson-et-al.pdf (2019).

38. Cumulative confirmed COVID-19 deaths. Our World in Data https://ourworldindata.org/coronavirus-data-explorer.

39. Cumulative confirmed COVID-19 deaths per million people. Our World in Data https://ourworldindata.org/coronavirus-data-explorer.

40. Bassot, É. Ten opportunities for Europe post-coronavirus. https://www.europarl.europa.eu/RegData/etudes/IDAN/2020/652035/EPRS_IDA(2020)652035_EN.pdf (2020).

41. NICOLÁS, E. S. Von der Leyen concedes mistakes in vaccine rollout. EUobserver https://euobserver.com/coronavirus/150889 (2021).

42. Tegmark, M. Life 3.0: Being Human in the Age of Artificial Intelligence. (Knopf, 2017).

43. Global Catastrophic Risks 2020. https://globalchallenges.org/wp-content/uploads/Global-Catastrophic-Risks-2020-Annual-Report.pdf (2020).

44. Sotala, K. & Yampolskiy, R. V. Responses to catastrophic AGI risk: a survey. Phys. Scr. 90, 018001 (2014).

45. Müller, V. C. & Bostrom, N. Future Progress in Artificial Intelligence: A Survey of Expert Opinion. in Fundamental Issues of Artificial Intelligence (ed. Müller, V. C.) 555–572 (Springer International Publishing, 2016). doi:10.1007/978-3-319-26485-1_33.

46. Grace, K., Salvatier, J., Dafoe, A., Zhang, B. & Evans, O. When Will AI Exceed Human Performance? Evidence from AI Experts. ArXiv170508807 Cs (2018).

47. Wiblin, R. & Harris, K. How well can we actually predict the future? 80,000 Hours https://80000hours.org/podcast/episodes/katja-grace-forecasting-technology/ (2018).

48. High-Level Expert Group on Artificial Intelligence. Shaping Europe’s digital future – European Commission https://ec.europa.eu/digital-single-market/en/high-level-expert-group-artificial-intelligence (2018).

49. Eetikasuunised usaldusväärse tehisintellekti arendamiseks. https://www.europarl.europa.eu/meetdocs/2014_2019/plmrep/COMMITTEES/JURI/DV/2019/11-06/Ethics-guidelines-AI_ET.pdf (2019).

50. Metzinger, T. Ethics washing made in Europe. https://www.tagesspiegel.de/politik/eu-guidelines-ethics-washing-made-in-europe/24195496.html (2019).

51. Tehisintellekt: Euroopa käsitus tipptasemel ja usaldusväärsest tehnoloogiast. https://ec.europa.eu/info/sites/info/files/commission-white-paper-artificial-intelligence-feb2020_et.pdf (2020).

52. LISTE DES POINTS PRÉVUS POUR FIGURER A L’ORDRE DU JOUR DES PROCHAINES RÉUNIONS DE LA COMMISSION. https://ec.europa.eu/transparency/regdoc/rep/2/2021/EN/SEC-2021-2365-F1-EN-MAIN-PART-1.PDF (2021).

53. Belfield, H. et al. Response to the European Commission’s consultation on AI. Centre for the Study of Existential Risk https://www.cser.ac.uk/news/response-european-commissions-consultation-ai/ (2020).

54. Torges, S. & Anderljung, M. Consultation on the European Commission’s White Paper on Artificial Intelligence: a European approach to excellence and trust. https://www.fhi.ox.ac.uk/wp-content/uploads/EU-White-Paper-Consultation-Submission-GovAI-Oxford.pdf (2020).

([1]) Väärtustega ühildamata tehisintellekt tähendab seda, et tehisintellekt võib tuua ootamatuid ja soovimatuid tulemusi, kuna tehisintellekti arendajad (ja ühiskond üldiselt) ei suuda piisavalt hästi eesmärke sõnastada ja tehisintellektile edasi anda.

([2]) T. Ord – Oxfordi ülikooli vanemteadur, filosoofia doktorikraad Oxfordi ülikoolist (toby-ord-cv.pdf (amirrorclear.net)); O. Cotton-Barratt – Oxfordi ülikooli Future of Humanity Institute’i teadusprogrammi direktor, matemaatika doktorikraad Oxfordi ülikoolist (Owen Cotton-Barratt – Future of Humanity Institute (ox.ac.uk)); A. Sandberg – Oxfordi ülikooli Future of Humanity Institute’i vanemteadur, neuroteaduse doktorikraad Stockholmi ülikoolist (Anders Sandberg – Wikipedia); N. Bostrom – Oxfordi ülikooli filosoofiaprofessor, filosoofia doktorikraad London School of Economicsist (cv.pdf (nickbostrom.com).

([3]) Geoinseneering on kliimamuutmise tehnoloogia, mille kõige tuntumad kasutusalad on päikesekiirguse juhtimine ja süsinikdioksiidi eemaldamine atmosfäärist (Climate engineering – Wikipedia).

([4]) Üldintellekti all mõistetakse inimtasemel tehisintellekti, millel on üldine võimekus õppida lahendama paljusid erinevaid ülesandeid.

Veel Pikksilma artikleid

Tervise- ja heaolutehnoloogiad1 on muutunud inimkeskseks. See tähendab, et igaüks peab oma tervist ja elu puudutavaid valikuid tehes üha enam ise vastutust võtma ja initsiatiivi haarama. Uudsete tehnoloogiliste lahenduste kasutamine nõuab aga nii tervishoiutöötajalt kui ka tavainimeselt uusi pädevusi, lisaks tuleb tehnoloogia potentsiaali rakendamiseks esmalt lahendada rida valdkonnaspetsiifilisi probleeme. Muu hulgas tuleb tagada, et kõigil inimrühmadel oleks tervise- ja heaolutehnoloogiatele võrdne ligipääs ning oskused ja võimalused uudsete lahenduste kasutamiseks.

Eesti põllumajanduse tulevikku kujundavad rahvusvahelise kaubanduse reeglite ja võimaluste muutumine, vajadus kindlustada toidujulgeolek ning Euroopa Liidu ühise põllumajanduspoliitika (ÜPP) toetused ja piirangud, milles üha olulisemal kohal on kliima- ja keskkonnahoid. Täiendavalt mõjutab sektorit biotehnoloogia areng, mille viljadest osasaamine eeldab algatusvõimelist tegutsemist. Oluline on mõista, millised uued võimalused võivad nende tegurite koosmõjul kujuneda ning kuidas olla valmis neid võimalusi kasutama, kirjutab Tallinna Ülikooli emeriitprofessor ja projektijuht Erik Terk.

Vajaduspõhiste toetuste õiglasel määramisel on vaja usaldusväärseid leibkonnaandmeid, sest inimese toimetulek ei sõltu üksnes tema isiklikust sissetulekust, vaid ka leibkonna koosseisust ja ühiste ressursside jagamisest. Eestis puuduvad usaldusväärsed ja terviklikud leibkonnaandmed, mis takistab toetuste tõhusamat sihtimist. Appi saavad tulla privaatsust tagavad tehnoloogiad, kirjutavad Liina Kamm ja Dan Bogdanov ettevõttest Cybernetica.

Viimased uudised

-

27.04 2026Kas ootused noortele on usaldusest kõrgemad?

Vananevas ühiskonnas ootame noortelt üha enamat, kuid kas anname neile ka piisavalt otsustusõigust? Jõuame noorte autonoomia paradoksini, kus kasvavate ootustega ei käi alati kaasas piisav usaldus ega toetus. Arenguseire Keskuse noorte autonoomia seminaril arutleti, kuidas muutunud otsustuskeskkond ja eriti digimaailm mõjutavad noorte otsuseid ning miks väljakujunenud süsteemid ei pruugi nende arenguga sammu pidada.

Riigikogu juures tegutsev sõltumatu mõttekoda

Riigikogu juures tegutsev sõltumatu mõttekoda